練習。

UCI Machine Learning Repository: Wine Quality Data Set

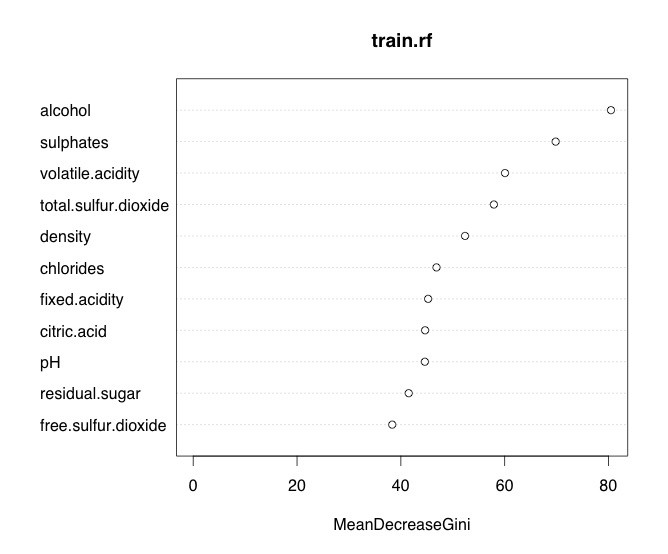

hoge=sample(1:1599,900) #900件をトレーニング用に train=wine[hoge,] test=wine[-hoge,] # 0.66くらい相関がある特徴があったけど、とりあえずただの線形回帰 train.lm=lm(data=train,quality~.) wine.pred=predict(train.lm,newdata = test) mse(test$quality,wine.pred) #√mseです #0.6576445 #ランダムフォレスト #mtryはTunerfより train.rf=randomForest::randomForest(data=train,quality~.,mtry=3) wine.pred.rf=predict(train.rf,newdata = test) mse(test$quality,wine.pred.rf) #0.6297493 #多少良くなった

正則化、PCAでは特に削れる特徴量はなさそうでした。 quality=7,8の時の誤差が大きいのは気になるけど(-1.0くらい)、どーなんでしょう。

夏場は炭酸が多いけど、赤ワインは基本毎日飲んでます。800円付近のネロ・ダヴォラ、サンライズ、ボルドーあたり。就職したらデイリーワインに1500円くらい使ってみたいですね(´;ω;`)ブワッ